ഇസ്രയേൽ പ്രധാനമന്ത്രി ബെഞ്ചമിൻ നെതന്യാഹുവിനെ ചുറ്റിപ്പറ്റിയുള്ള സമീപകാല വിവാദങ്ങൾ ആഗോളതലത്തിൽ തന്നെ വലിയ ചർച്ചകൾക്ക് വഴിവെച്ചിരിക്കുകയാണ്. അദ്ദേഹം ജീവിച്ചിരിപ്പുണ്ടോ അതോ ഇപ്പോൾ പുറത്തുവരുന്നത് ആർട്ടിഫിഷ്യൽ ഇന്റലിജൻസ് (എഐ) നിർമ്മിത വീഡിയോകളാണോ എന്ന സംശയമാണ് സോഷ്യൽ മീഡിയയിൽ പടരുന്നത്. 2026 മാർച്ചിൽ പുറത്തുവന്ന ചില വീഡിയോകളിൽ അദ്ദേഹത്തിന്റെ കൈവിരലുകളുടെ എണ്ണത്തിലും കാപ്പി കുടിക്കുമ്പോഴുള്ള ദൃശ്യങ്ങളിലും കണ്ട അസ്വാഭാവികതയാണ് ഈ 'ഡീപ് ഫേക്ക് ' സംശയങ്ങൾക്ക് ആധാരം.

ഒരു ടെക് ജേണലിസ്റ്റ് എന്ന നിലയിൽ, ഈ സാഹചര്യത്തെ മുൻനിർത്തി എഐ വീഡിയോകൾ എങ്ങനെ തിരിച്ചറിയാം എന്നും ഇത്തരം തട്ടിപ്പുകളിൽ നിന്ന് എങ്ങനെ രക്ഷപ്പെടാം എന്നും പരിശോധിക്കാം.

എത്ര കൃത്യതയോടെ നിർമ്മിച്ചാലും എഐ വീഡിയോകളിൽ ചില സാങ്കേതിക പിഴവുകൾ (Artifacts) ഒളിഞ്ഞിരിപ്പുണ്ടാകും. അവ ശ്രദ്ധിച്ചാൽ നമുക്ക് വ്യാജനെ തിരിച്ചറിയാം:

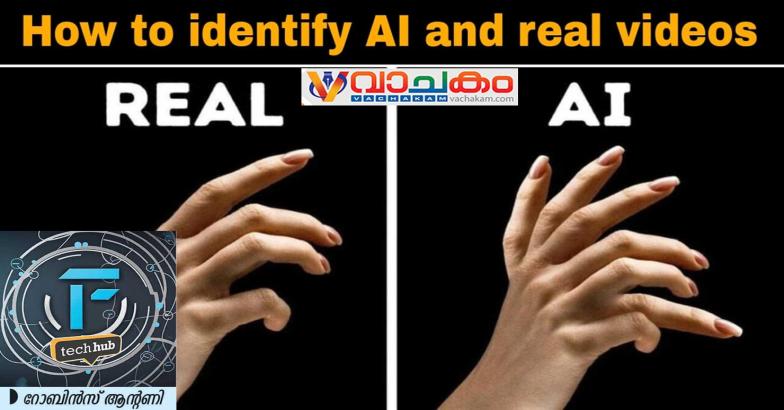

1. കൈവിരലുകളും ചലനങ്ങളും: എഐക്ക് ഇപ്പോഴും മനുഷ്യന്റെ കൈവിരലുകൾ കൃത്യമായി ചിത്രീകരിക്കുന്നതിൽ പരിമിതികളുണ്ട്. നെതന്യാഹുവിന്റെ വീഡിയോയിൽ കണ്ടതുപോലെ വിരലുകളുടെ എണ്ണം കൂടുകയോ, വിരലുകൾ തമ്മിൽ ഒട്ടിയിരിക്കുകയോ ചെയ്യുന്നത് ശ്രദ്ധിക്കുക.

2. കണ്ണുകളുടെ തിളക്കവും ചിമ്മലും: സാധാരണ മനുഷ്യർ കൃത്യമായ ഇടവേളകളിൽ കണ്ണ് ചിമ്മാറുണ്ട്. എഐ വീഡിയോകളിൽ കണ്ണ് ചിമ്മുന്നത് വളരെ കുറവായതോ അല്ലെങ്കിൽ അസ്വാഭാവികമായ രീതിയിലോ ആയിരിക്കും. കണ്ണിലെ പ്രതിഫലനം (Reflection) പരിസരവുമായി യോജിക്കുന്നുണ്ടോ എന്നും നോക്കുക.

3. ലിപ് സിങ്കിംഗിലെ പിഴവുകൾ: സംസാരിക്കുമ്പോൾ ചുണ്ടുകളുടെ ചലനവും ശബ്ദവും തമ്മിൽ നേരിയ വ്യത്യാസം ഉണ്ടായേക്കാം. 'ബി', 'പി', 'എം' തുടങ്ങിയ അക്ഷരങ്ങൾ ഉച്ചരിക്കുമ്പോൾ ചുണ്ടുകൾ പൂർണ്ണമായും കൂട്ടിമുട്ടുന്നുണ്ടോ എന്ന് പരിശോധിക്കുക.

4. അസ്വാഭാവികമായ ചർമ്മം: എഐ രൂപങ്ങളുടെ ചർമ്മം പലപ്പോഴും വളരെയധികം മിനുസമുള്ളതായോ (Plasticlike) അല്ലെങ്കിൽ അമിതമായി വെളുത്തതോ ആയി തോന്നും. മനുഷ്യ ചർമ്മത്തിലെ ചുളിവുകളോ ചെറിയ പാടുകളോ എഐ വീഡിയോകളിൽ കുറവായിരിക്കും.

5. പശ്ചാത്തലത്തിലെ മാറ്റങ്ങൾ: വീഡിയോയിലെ വ്യക്തിയുടെ തല അനങ്ങുമ്പോൾ മുടിയുടെ അഗ്രങ്ങൾ മങ്ങുകയോ പശ്ചാത്തലവുമായി ലയിക്കുകയോ ചെയ്യുന്നുണ്ടെങ്കിൽ അത് വ്യാജനാകാൻ സാധ്യതയുണ്ട്.

നമുക്ക് പരിചയമുള്ളവരായി എഐ എങ്ങനെ വേഷം മാറുന്നു?

തട്ടിപ്പുകാർ ഇപ്പോൾ സാധാരണക്കാരെ ലക്ഷ്യം വെക്കുന്നത് 'ഇംപേഴ്സണേഷൻ' വഴിയാണ്.

ഇത്തരം തട്ടിപ്പുകളിൽ നിന്ന് എങ്ങനെ സ്വയം സംരക്ഷിക്കാം?

1. പെട്ടെന്നുള്ള പണമിടപാടുകൾ ഒഴിവാക്കുക: വീഡിയോ കോളിൽ ഒരാൾ പണം ചോദിച്ചാൽ ഉടൻ നൽകരുത്. ആ വ്യക്തിയെ മറ്റൊരു ഫോണിൽ വിളിച്ച് നേരിട്ട് സംസാരിച്ച് ഉറപ്പുവരുത്തുക.

2. ഫാമിലി 'സേഫ് വേർഡ് ' (Safe Word): കുടുംബാംഗങ്ങൾക്കിടയിൽ മാത്രം അറിയാവുന്ന ഒരു രഹസ്യവാക്ക് നിശ്ചയിക്കുക. അത്യാവശ്യ ഘട്ടങ്ങളിൽ വിളിക്കുന്ന ആൾ യഥാർത്ഥ വ്യക്തിയാണോ എന്ന് ഈ വാക്ക് ചോദിച്ച് ഉറപ്പിക്കാം.

3. സംശയം തോന്നിയാൽ ആക്ഷൻ ആവശ്യപ്പെടുക: ഒരു വീഡിയോ കോൾ വ്യാജമാണെന്ന് തോന്നിയാൽ, വിളിച്ച വ്യക്തിയോട് മുഖത്തിന് കുറുകെ കൈ വീശാനോ അല്ലെങ്കിൽ സൈഡിലേക്ക് തിരിയാനോ ആവശ്യപ്പെടുക. തത്സമയ എഐ വീഡിയോകളിൽ ഇത്തരം ചലനങ്ങൾ കൃത്യമായി വരണമെന്നില്ല.

4. സോഷ്യൽ മീഡിയ പ്രൈവസി: നിങ്ങളുടെ ശബ്ദവും വീഡിയോകളും സോഷ്യൽ മീഡിയയിൽ പബ്ലിക് ആയി പങ്കുവെക്കുന്നത് കുറയ്ക്കുക. തട്ടിപ്പുകാർക്ക് ഡീപ് ഫേക്ക് നിർമ്മിക്കാനുള്ള അസംസ്കൃത വസ്തുക്കൾ ഇവയാണ്.

സാങ്കേതികവിദ്യ വളരുമ്പോൾ നമ്മുടെ ജാഗ്രതയും വർദ്ധിക്കേണ്ടതുണ്ട്. കാണുന്നതെല്ലാം സത്യമല്ലെന്ന് തിരിച്ചറിഞ്ഞ് പ്രവർത്തിക്കുകയാണ് ഈ കാലഘട്ടത്തിൽ അനിവാര്യം.

റോബിൻസ് ആന്റണി

വാചകം ന്യൂസ് വാട്ട്സ് ആപ്പ് ഗ്രൂപ്പിൽ പങ്കാളിയാകുവാൻ

ഇവിടെ ക്ലിക്ക് ചെയ്യുക

.

വാട്സ്ആപ്പ്:ചാനലിൽ അംഗമാകാൻ ഇവിടെ ക്ലിക്ക് ചെയ്യുക .

ഫേസ്ബുക് പേജ് ലൈക്ക് ചെയ്യാൻ ഈ ലിങ്കിൽ (https://www.facebook.com/vachakam/) ക്ലിക്ക് ചെയ്യുക.

യൂട്യൂബ് ചാനൽ:വാചകം ന്യൂസ്

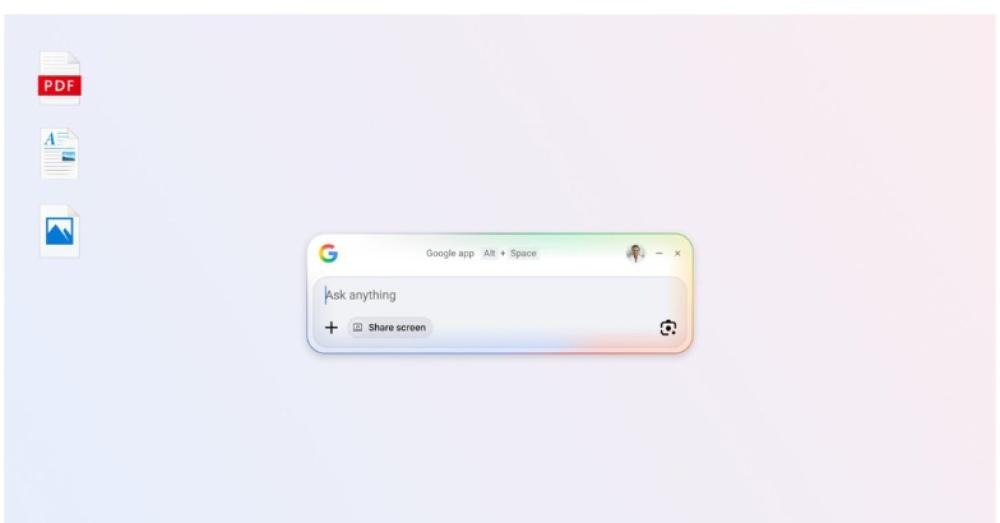

വിൻഡോസ് ഉപയോക്താക്കൾക്കായി ഗൂഗിൾ ഡെസ്ക്ടോപ്പ് ആപ്പ് എത്തി; എഐ ഫീച്ചറുകളും ഗൂഗിൾ ലെൻസും

വിൻഡോസ് ഉപയോക്താക്കൾക്കായി ഗൂഗിൾ ഡെസ്ക്ടോപ്പ് ആപ്പ് എത്തി; എഐ ഫീച്ചറുകളും ഗൂഗിൾ ലെൻസും

ഡ്രൈവിംഗിനിടെ വാട്ട്സ്ആപ്പ് സന്ദേശങ്ങൾ അയക്കാൻ ഇനി ടെൻഷൻ വേണ്ട; സുരക്ഷിതമായ പുതിയ ഫീച്ചർ

ഡ്രൈവിംഗിനിടെ വാട്ട്സ്ആപ്പ് സന്ദേശങ്ങൾ അയക്കാൻ ഇനി ടെൻഷൻ വേണ്ട; സുരക്ഷിതമായ പുതിയ ഫീച്ചർ

-20260416085049.jpg) ഫോൺ നമ്പർ ഉപയോഗിച്ച് ഒരാളുടെ ലൊക്കേഷൻ കണ്ടെത്താനാകുമോ? ഇന്റർനെറ്റിലെ തട്ടിപ്പുകളിൽ വീഴാതിരിക്കാൻ ഇക്കാര്യങ്ങൾ

ഫോൺ നമ്പർ ഉപയോഗിച്ച് ഒരാളുടെ ലൊക്കേഷൻ കണ്ടെത്താനാകുമോ? ഇന്റർനെറ്റിലെ തട്ടിപ്പുകളിൽ വീഴാതിരിക്കാൻ ഇക്കാര്യങ്ങൾ

നിങ്ങളുടെ വാട്സാപ്പ് പ്രൊഫൈലിൽ ഇനി ഇൻസ്റ്റാഗ്രാം ലിങ്കും നൽകാം! പുതിയ സുരക്ഷാ ഫീച്ചറുകൾ

നിങ്ങളുടെ വാട്സാപ്പ് പ്രൊഫൈലിൽ ഇനി ഇൻസ്റ്റാഗ്രാം ലിങ്കും നൽകാം! പുതിയ സുരക്ഷാ ഫീച്ചറുകൾ